(Technologie Przyszłości: Rozwój i Aplikacyjne Zastosowania Sztucznej Inteligencji)

Data i miejsce: 14 listopad 2025, Akademia WSEI, Lublin, Polska

🌐 Strona konferencji: https://conf.nx365.ai

🎥 Nagrania z konferencji dostępne są na YouTube:

Wydarzenie zorganizowano w ramach inicjatywy nx365.ai jako cykl warsztatów poświęconych praktycznym zastosowaniom nowoczesnej sztucznej inteligencji w medycynie, przemyśle i sektorze usług.

W spotkaniu uczestniczyli przedstawiciele środowiska akademickiego, firm technologicznych, centrów badawczych oraz biznesu. Program obejmował wykłady wprowadzające i technologiczne, trzy sesje tematyczne oraz podsumowanie poświęcone wnioskom z dyskusji.

Warsztaty zainaugurowano krótką prezentacją celu wydarzenia. Podkreślono konieczność łączenia badań naukowych z wdrożeniami w realnych środowiskach medycznych i przemysłowych oraz znaczenie współpracy uczelni, firm technologicznych i użytkowników końcowych systemów AI.

Zwrócono uwagę na rosnącą rolę sztucznej inteligencji jako kluczowej technologii transformującej diagnostykę, optymalizację procesów oraz sposób projektowania nowoczesnych usług cyfrowych.

Pierwszy wykład wprowadzający wygłoszony przez prof. Tomasza Rymarczyka poświęcono przeglądowi zastosowań sztucznej inteligencji w systemach medycznych. Przedstawiono podział metod na uczenie maszynowe i głębokie, zwracając uwagę na komplementarny charakter konwolucyjnych sieci neuronowych, modeli sekwencyjnych typu LSTM oraz dużych modeli językowych. Podkreślono, że w praktyce klinicznej AI stanowi zestaw wąsko wyspecjalizowanych narzędzi analizujących obrazy, sygnały, mowę oraz dokumentację tekstową.

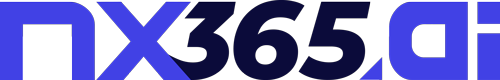

Zaprezentowano liczne przykłady wykorzystania algorytmów w analizie obrazów tomograficznych, sygnałów EKG i EEG, rekonstrukcji obrazów przy obniżonej dawce promieniowania oraz automatycznej analizie dokumentacji medycznej. Omówiono także rozwój oprogramowania wspierającego lekarzy w podejmowaniu decyzji diagnostycznych i terapeutycznych, w tym platformę e-Medicus oraz rozwiązania noszone do nieinwazyjnego monitorowania stanu pacjenta. Na slajdach pokazano prototypowe systemy tomograficzne, kamizelki i pasy diagnostyczne oraz system monitorowania kaszlu wraz z aplikacją webową i mobilną.

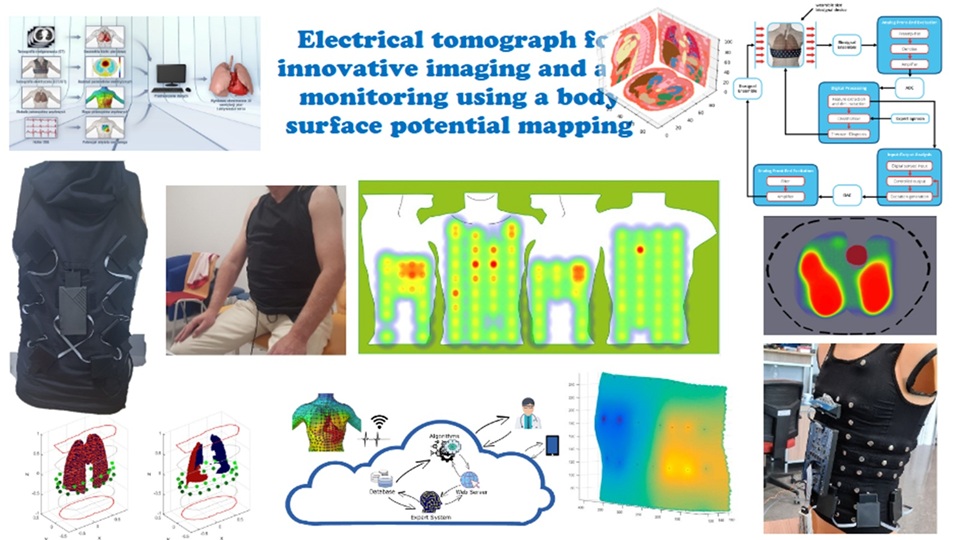

Dr inż. Dariusz Wójcik przedstawił wykład technologiczny poświęcony nowej generacji modeli wizji komputerowej opartych na koncepcji tak zwanych Vision Tokens. Omówiono współczesne systemy OCR, architektury multimodalne łączące obraz i tekst oraz metody kompresji optycznej wykorzystywane w modelu DeepSeek-OCR. Na przykładach pokazano proces przetwarzania dokumentów, wykresów oraz złożonych układów graficznych na reprezentacje możliwe do dalszego rozumienia przez modele językowe.

Wystąpienie obejmowało wprowadzenie do autoenkoderów, wariacyjnych autoenkoderów VAE oraz ich wersji z wektorową kwantyzacją VQ-VAE, podkreślając rolę reprezentacji ukrytej jako centralnego pojęcia we współczesnym uczeniu głębokim. Zaprezentowano także architekturę CLIP oraz sposób kodowania obrazów i tekstu we wspólnej przestrzeni cech. Podsumowując wykład wskazano, że rozwój Vision Tokens i modeli multimodalnych otwiera drogę do nowej jakości analizy dokumentów, obrazu technicznego i medycznego oraz do budowy systemów, które nie wymagają klasycznych tokenizerów tekstowych.

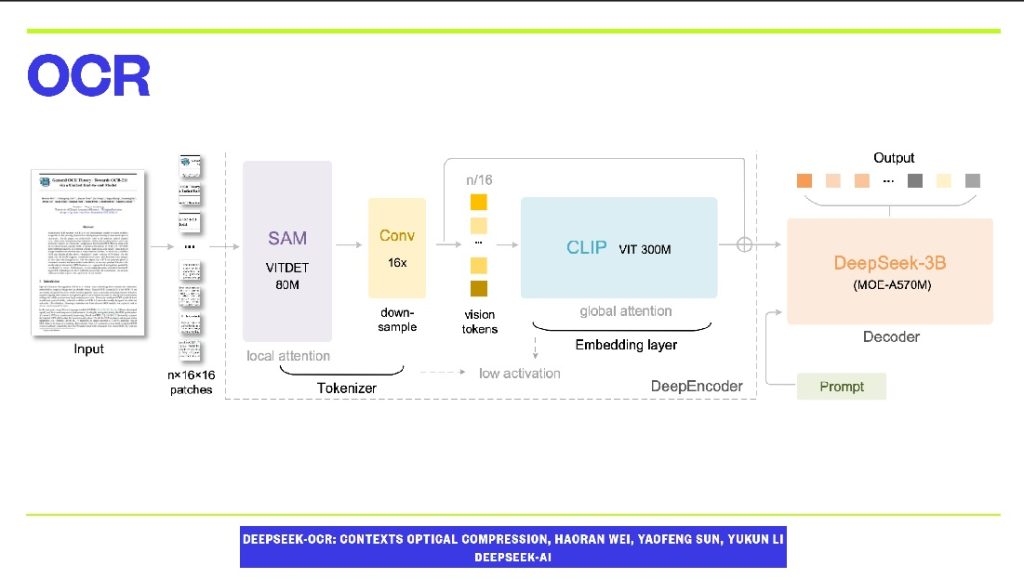

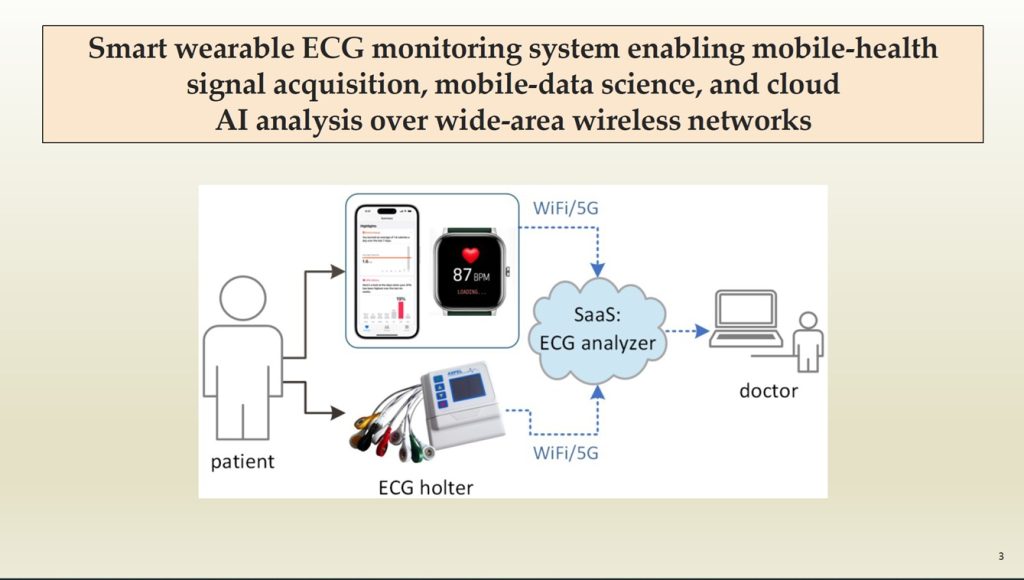

Dr inż. Grzegorz Kłosowski zaprezentował koncepcję inteligentnego systemu klasyfikacji sygnałów EKG, który wykorzystuje urządzenia noszone w połączeniu z modelem usługowym SaaS.

Rozwiązanie obejmuje pozyskiwanie sygnału z sensorów, przesyłanie danych do chmury, zastosowanie algorytmów klasyfikacji oraz udostępnianie wyników lekarzowi i pacjentowi w

formie aplikacji. Podkreślono potencjał tego typu systemów w kontekście zdalnego monitorowania pacjentów kardiologicznych i wczesnego wykrywania zaburzeń rytmu serca.

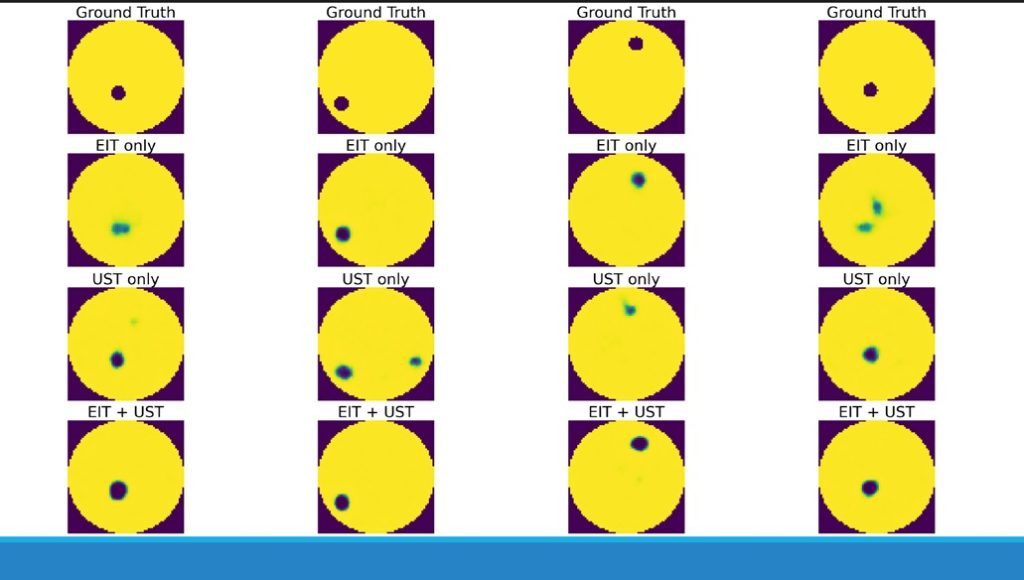

Kolejna prezentacja to zastosowanie uczenia maszynowego w hybrydowym podejściu łączącym tomografię impedancyjną (EIT) i ultradźwiękową (UST).

Zbudowano multimodalny model neuronowy dokonujący fuzji danych z obu metod, co pozwoliło na uzyskanie niższego błędu predykcji w porównaniu do modeli opartych na pojedynczej modalności. Metoda hybrydowa osiągnęła najwyższe wartości wskaźników jakości obrazu PSNR i SSIM na zbiorze testowym.

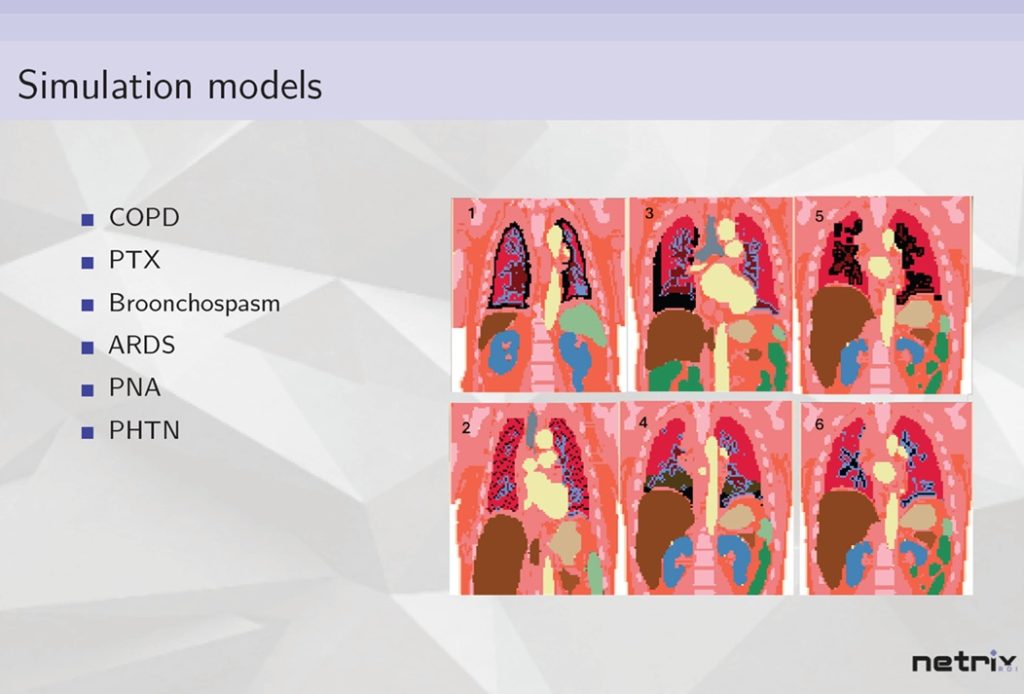

Autorka kolejnego wystąpienia przedstawia proces tworzenia modelu klasyfikacyjnego dla 7 stanów patologicznych płuc (m.in. POChP, odma, zapalenie płuc) w oparciu o dane symulacyjne EIT.

Zastosowano architekturę EfficientNetV2 z Transformerem do analizy 4D (czas i przestrzeń). Model walidowano na danych rzeczywistych, wskazując na wyzwania związane z błędną klasyfikacją osób zdrowych jako chorych oraz konieczność zaawansowanego przetwarzania wstępnego sygnału.

Autor innego referatu analizuje metody sterowania silnikami DC w aplikacjach przemysłowych, w tym regulację napięcia, PWM oraz sterowanie prądowe. Omówiono implementację regulatora PID w mikrokontrolerze, uwzględniając problemy takie jak obsługa obciążenia, grawitacja oraz różne tryby hamowania (aktywne, pasywne, nawrotne). Przedstawiono fragmenty kodu odpowiedzialne za logikę sterowania.

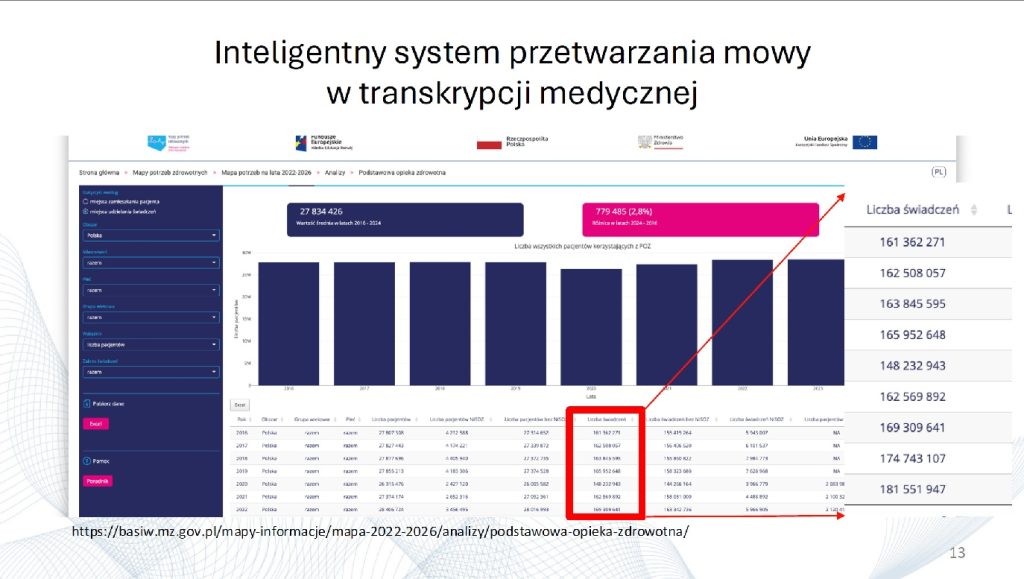

Projekt kolejnego wystąpienia skupiał się na automatyzacji dokumentacji medycznej przy użyciu algorytmów NLP/NLU dedykowanych dla języka polskiego.

System ma na celu odciążenie personelu medycznego poprzez transkrypcję mowy na tekst w czasie rzeczywistym, ekstrakcję danych medycznych (objawy, diagnoza, leki) i automatyczne wypełnianie formularzy. Prezentacja pokazuje status prac, w tym prototypy interfejsu (dashboard lekarza) oraz urządzenia brzegowe do akwizycji dźwięku.

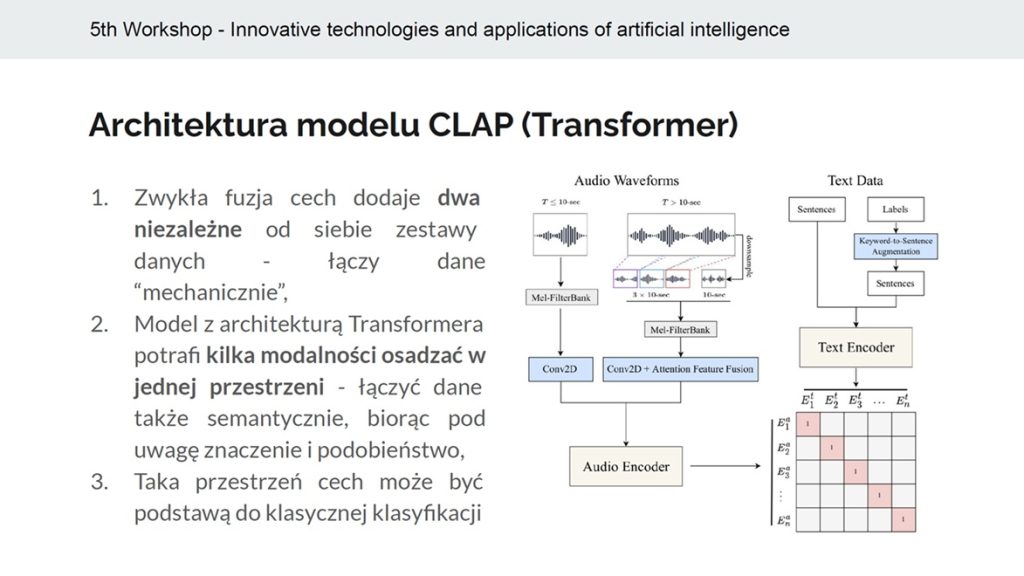

Następna prezentacja dotyczyła badania stanów depresyjnych na podstawie analizy głosu przy użyciu modelu CLAP opartego na architekturze Transformera.

Autor porównuje klasyczne metody uczenia maszynowego (Random Forest, Regresja Logistyczna) na cechach MFCC i eGeMAPS z podejściem multimodalnym łączącym dźwięk i tekst. Wyniki wskazują, że standardowe metody klasyfikacji są niewystarczające, a zastosowanie embeddingów i sieci neuronowych (np. CNN) pozwala na lepsze uchwycenie nieliniowych zależności w czasie.

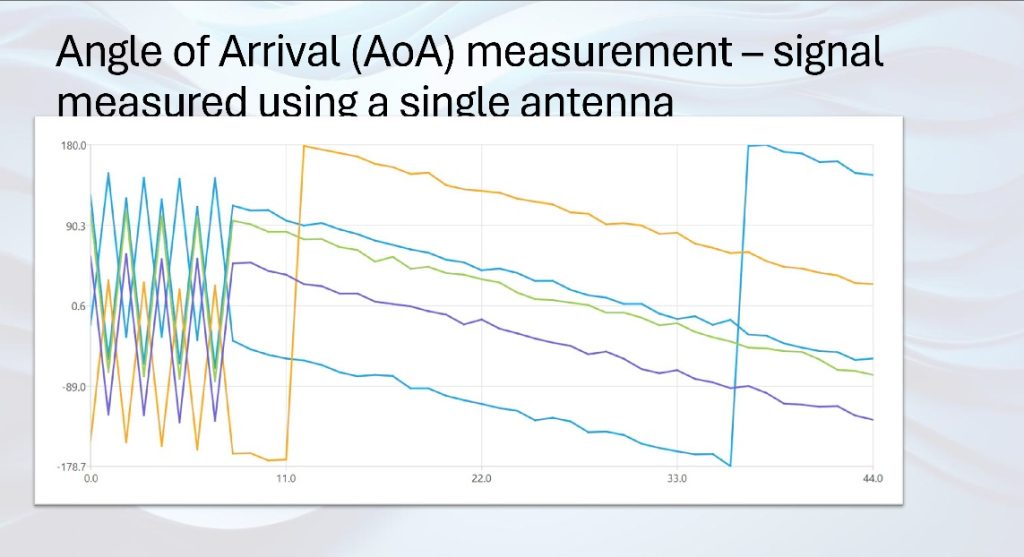

Kolejny referat przybliża mechanizmy kierunkowego pozycjonowania w standardzie Bluetooth 5.1 plus, w szczególności tryb Direction Finding z wykorzystaniem metod AoA i AoD.

Omówiono pasmo i strukturę kanałów BLE, modulację GFSK, budowę pakietu z rozszerzeniem CTE oraz sposób wyznaczania kąta nadejścia sygnału na podstawie pomiaru fazy na macierzy anten, co stanowi bazę do budowy energooszczędnych systemów lokalizacji o wysokiej precyzji.

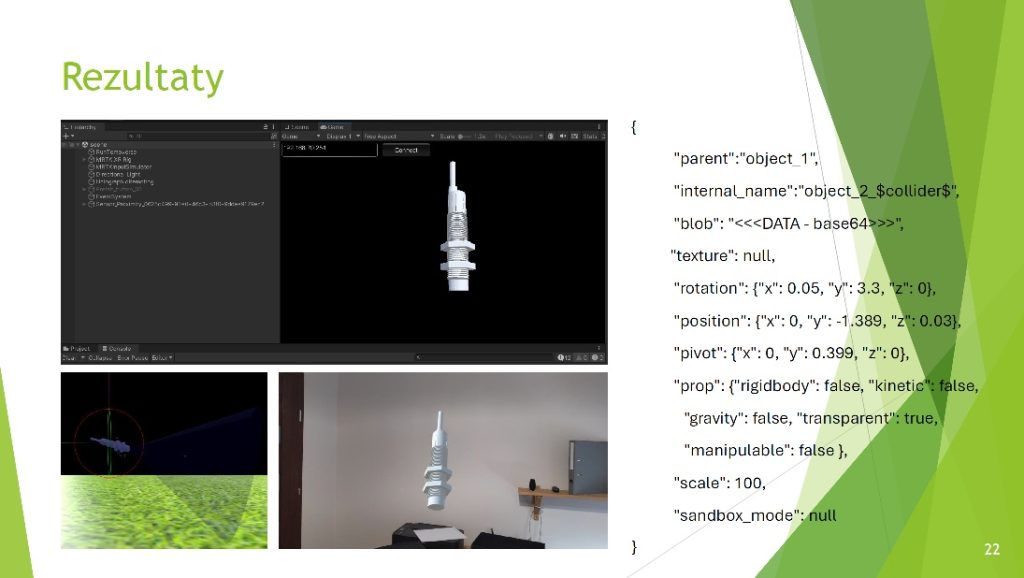

Wystąpienie następne wprowadza pojęcie jednostki holograficznej jako semantycznego bytu w rzeczywistości mieszanej, który łączy geometrię 3D, zachowanie, komunikację sieciową i tożsamość oraz może pełnić rolę elementu cyfrowego bliźniaka w systemach tomografii przemysłowej.

Omówiono afordancje i typy interakcji z hologramami, warstwy interoperacyjności pomiędzy różnymi platformami XR oraz ogólne wymagania projektowe, ilustrując koncepcję na przykładzie systemu TomoVerse i struktury Hyleidos.

Następna prezentacja opisuje specyfikę rynku FMCG z jego wysoką rotacją produktów, sezonowością, licznymi promocjami i rozproszoną siecią punktów sprzedaży oraz pokazuje, że tradycyjne analizy ręczne nie nadążają za złożonością danych.

Zaprezentowano koncepcję systemu DSS z modułami AI i ML, obejmującymi segmentację klientów, predykcję zamówień, scoring potencjału sklepów i detekcję anomalii, który zamyka lukę między gromadzeniem danych a realnymi decyzjami operacyjnymi w terenie.

Warsztaty piątej edycji potwierdziły, że sztuczna inteligencja staje się infrastrukturą krytyczną nowoczesnej medycyny i przemysłu oraz jednym z głównych kierunków rozwoju działalności badawczo rozwojowej. Przedstawione referaty pokazały pełne spektrum zastosowań od zaawansowanych systemów diagnostycznych i urządzeń noszonych, przez platformy transkrypcji mowy i analizy dokumentów, po przemysłowe zastosowania interdyscyplinarne AI oraz inżynierii oprogramowania.

Podkreślono znaczenie tworzenia rozwiązań end to end łączących warstwę sprzętową, algorytmiczną i chmurową, a także konieczność zapewnienia wysokiej jakości danych, bezpieczeństwa oraz zgodności z regulacjami sektora medycznego i przemysłowego.

Warsztaty stanowiły ważną platformę wymiany doświadczeń pomiędzy zespołami badawczymi i partnerami przemysłowymi oraz potwierdziły rosnącą rolę ekosystemu nx365.ai jako miejsca integrującego projekty z obszaru sztucznej inteligencji, sensorów, systemów IT oraz nowoczesnych zastosowań przemysłowych i medycznych.